Interact

Sommaire

First Session

Capteurs choisis :

* Capteur de rythme cardiaque

* Capteur de chaleur

* Capteur de proximité (facultatif).

The Context

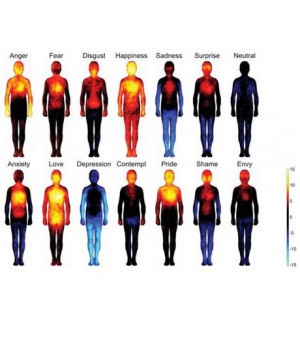

Il existe une étude réalisée par des scientifiques finlandais qui ont évalué l'augmentation ou la diminution d'activité des différentes zones du corps en fonction des émotions. A partir de cette étude, ils ont ainsi pu dresser une cartographie sur laquelle on observe quelles parties du corps réagissent selon le ressenti (voir Figure.1).

Main Idea

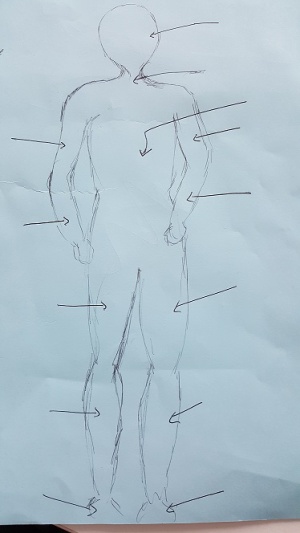

En nous basant sur l'étude qui relie la chaleur du corps humain aux différentes émotions ressenties ==> On souhaite créer une panoplie avec un afficheur capable d'afficher du texte ou une image relatifs à ces émotions. L'intitulé de notre projet est "Interact", et ce pour une raison bien précise. Partant de ce principe, nous souhaitons que la panoplie que nous allons élaboré puisse permettre à son porteur d’interagir avec l'environnement qui l'entoure, plus précisément avec les personnes qui peuvent influencer son changement d'humeur,et leur montrer via un texte ou une image implantés sur un support textile que porte cette personne son ressenti à leur égard. Pour réaliser notre projet, nous avons jugé qu'il était nécessaire d'accompagner un capteur de chaleur d'un capteur de rythme cardiaque pour avoir plus de précision en terme de données collectées sur la personne et pouvoir ainsi différencier entre un changement de température découlant d'un événement externe au corps(exposition au soleil, climat...), d'un changement de température dû à un ressenti interne. Nous avons également eu l'idée d'ajouter un capteur de proximité ou une camera thermique qui permettrait de détecter les personnes proches et analyser l'influence de leur rapprochement ou leur éloignement et leur impact sur les émotions. On a choisi de placer les différents capteurs dans différentes zones du corps afin d'avoir le plus de données et d'efficacité possible (Voir Figure.2).

On peut citer par exemple le cas où si une personne pour qui nous portons de l'affection se rapproche, nous aurons tendance à être plus à l'aise et plus content comparé à la présence d'une personne qui nous intimide. Pour ce qui est de l'afficheur, nous pensons utiliser principalement des afficheur à LEDs, où on afficherait soit des textes qui expriment nos sentiments "Votre présence me fait plaisir" ou "Je ne me sens pas bien". Ou bien, on pourrait envisager de mettre des images ou des smileys qui s'allumeront en fonction du sentiment de la personne.

Objectives of the Second Session

Suite à la présentation de notre idée au reste du groupe et des professeurs, nous avons eu de bons retours sur les premières limites du projet, il nous reste donc à étudier la faisabilité et la viabilité de notre idée.

Second Session

Après une étude approfondie et une concertation générale, nous avons décidé d'orienter notre réflexion vers un scénario d'usage plus adapté et surtout que l'on serait en mesure d'étudier avec plus de précision étant donné que les émotions restent très relatives à chaque individu et abstraites, ainsi leur détection ne se serait pas faite de manière très exacte. Sachant que la surcharge du corps de la personne en capteurs à différents en droits, et qui plus doivent être en contact direct avec la peau consisterait un désagrément et freinerait la mobilité. De là nous avons opté pour un scénario plus approprié, à savoir la détection et l’interprétation des données d'un environnement externe à la personne et non ses données internes. Désormais, notre idée finale est de concevoir une panoplie dotée des capteurs suivants :

* Un capteur de rayons UV

* Un capteur de température

* Un capteur de particules pour déterminer la qualité de l'air

Nous avons gardé notre idée de base qui est d'afficher les informations directement sur le tee-shirt afin de maintenir l'interaction de la personne avec les personnes présentes dans l'environnement qui les entoure. Nous souhaitons par ailleurs équiper cette panoplie d'un dispositif qui permet de rappeler à la personne le nombre de verres d'eau qu'il a bu ou qu'il devra boire pendant la journée (un nombre que l'on pourra faire varier en fonction de la température ==> Plus il fera chaud plus il faudra s'hydrater).

Objectives of the Third Session

Réaliser une maquette en améliorant le design tout en ayant une idée fixe sur le scénario d'usage.

Third Session

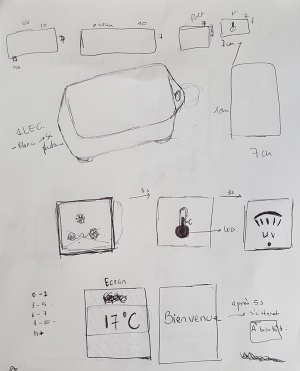

Nous avons essayé de rassembler les idées que nous avions eu dans la séance précédente et modéliser un prototype virtuel de notre panoplie qui sera un tee-shirt "intelligent" qui comporte toutes les données relatives à la température externe que nous avons modélisé par un thermomètre en haut à droite, des particules de poussière en arrière plan qui changent de couleur en fonction de la pureté de l'air environnant, et finalement , nous avons placé les données des capteurs de rayons UV sur les lunettes de soleil du personnage sur le tee-shirt ( présence de lunettes de soleil ==> Exposition à des rayons UV, Absence des lunettes de soleil ==> Pas/peu d'exposition aux UV). En ce qui concerne l'hydratation, nous avons choisi de la modéliser par un verre d'eau qui, suivant le nombre de verres d'eau que la personne porteuse de tee-shirt a bu, verra ses niveaux augmenter, jusqu'à ce que la personne atteigne le nombre minimal de verres d'eau qu'elle devra boire en une journée, pour ce faire nous avons décidé d'ajouter un bouton poussoir sur lequel la personne devra appuyer après avoir bu un verre d'eau et suivant le nombre de fois où cette personne a appuyé, elle verra le niveau d'eau augmenter. Cela-dit, nous étudions actuellement la possibilité de pouvoir augmenter les niveaux dans le verre en fonction de la température ( En effet, on devra s'hydrater plus si la température atteint 30° ) (Voir Figure.3 et Figure.4).

Fourth Session

Le scénario d’usage définit avant cette séance est : La panoplie est composée d’un t-shirt interactif. Ce t-shirt pourra expliquer de façon simple le taux d’humidité, la température et le taux d’UV auxquels l’utilisateur est exposé. Ainsi d’autres personnes ainsi que lui-même pourront avoir accès à ce genre d’informations dont on n’a pas l’accès en temps normal. Un autre type d’utilisation possible est à destination des enfants. Avec un pouvoir préventif qui permet aux parents d’avoir accès à ces informations ainsi que les enfants. Lors du travail préparatif de cette séance nous avons aussi réalisé des modèles à afficher sur l’écran composé d’un réseau de LED qui illuminent du papier vélin colorié et plastifié. Ce modèle a été réalisé par l’étudiante en école de design Valia Mouheich. Nous pouvons avoir un aperçu des modèles dans le compte rendu de la séance précédente.

Le système de capteur pourra être fixé par le biais de «Velcro» sur la panoplie. La connexion envisagée entre les capteurs et la carte sera filaire car la carte ainsi qu’une batterie sont dans le boitier fixable par velcro au t-shirt. . Et l’affichage est instantané sur panoplie. Cette connexion sera filaire aussi.

Work Done:

• Lors de cette séance nous avons perfectionné le scénario d’usage pour l’orienter sur une utilisation pour les enfants.

• Nous avons effectué des recherches sur les capteurs et les données à capter. Une recherche approfondie sur les phénomènes physiques captés a été réalisé. Cette compréhension permettra une utilisation et une mise en place plus facile des capteurs concernés.

• Une recherche plus approfondie sur l’état de l’art pour les t-shirts connectés ou les systèmes d’affichages sur les t-shirts interactifs

Feedbacks & Changes made:

Le scénario d’usage doit être changé. Nous devons choisir une nouvelle orientation pour ce projet. Une panoplie destinée aux enfants pour un usage préventif n’est peut-être pas une idée convaincante. Ainsi que le système d’affichage sur le t-shirt. Nous devons aussi revoir les modèles créés car ils ne permettent pas un affichage clair de l’information.

Nouvelles orientations :

Le nouveau scénario d’usage envisagé est le suivant : Nous gardons toujours le système de capteurs fixables par velcro ou d’une autre manière. Ce système communiquera sans fil avec un Smartphone où les données seront affichées de manière ludique. Un système de notifications pourra avertir l’utilisateur de mauvaises conditions ou informations importantes. Les informations sont ainsi plus faciles d’accès par l’utilisateur. On pourra ainsi viser un nombre plus grand nombre d’usagers potentiels. Nous sommes actuellement en train d’étudier la carte Raspberry Pi 2 et la connexion avec les capteurs et le Smartphone.

Fifth Session

Nos objectifs étant fixés et notre plan de travail étant établi, on a cherché lors de cette séance à améliorer notre scénario d'usage vu que l'idée du tee-shirt présentait plusieurs contraintes, comme par exemple le cas où il pleuvrait, ou bien lorsque le tee-shirt aurait besoin d'être lavé et donc nous avons orienté nos recherches vers la conception d'un objet que n'importe quelle personne serait en mesure de transporter avec elle et non pas le porter, ce qui lui permettrait d'avoir plus de liberté et plus de recul par rapport à l'objet (dont on définira le design par la suite). Nous avons donc opté pour un objet connecté et complètement autonome, vu qu'il sera alimenté par une batterie rechargeable. Il comportera l'ensemble des capteurs cités précédemment. Pour la data visualisation, l'objet sera doté d'un écran LCD pour afficher les données numériques et quelques messages relatifs aux données collectées.

Pour rappel, les données que nous allons captés sont : la température , la qualité de l'air environnant, et l'exposition aux rayons UV que l'on souhaite afficher de la manière suivante : Le degré de température, Le pourcentage de pollution de l'air avec un message relatif à la qualité de l'air (s'il est frais, si la pollution est faible ou haute) et finalement l'indice d'UV.

Nous souhaitons donc que notre objet finale ressemble un peu à ça :

Pre-Workshop Session

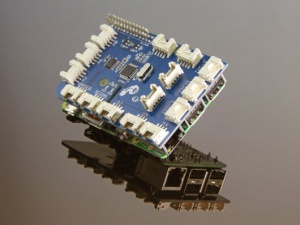

Prise en main de la carte Raspberry pi et familiarisation avec le système Raspbian. et Mise en place de la Grovepi avec toute les librairies nécessaires.

Nous avons connecté les deux premiers capteurs (Qualité d'air, Température et humidité) pour essayer de les faire fonctionner. les capteurs ont fonctionné indépendamment les uns des autres. Maintenant notre objectif est de faire fonctionner tous les capteurs en même temps.

Voici la Liste finale du matériel utilisé:

1 Raspberry Pi 2. 1 Grovepi. 1 capteur de qualité d'air. 1 capteur d'Humidité et de température. 1 capteur d'index UV. 1 LCD RGB avec backlight. 1 Buzzer pour prévenir en cas de danger. 3 LED qui vont permettre de signaler un un danger si on dépasse certains seuils.

Workshop Week

Day 1

• 9h - 11h15 : Réunion à l'IRAM avec les étudiants en communication de l'IRAM afin de présenter notre projet et assister à leur présentations

==> Sensibilisation à l'aspect écologique et collaboration entre les trois parties (TSE/ESADSE/IRAM).

• 11h15 - 12h00 : Retour à l'ESADSE - Approvisionnement/Installation du matériel.

• 13h30 - 16h30 : Début de la phase de programmation avec pour objectif la création d'un seul programme Python capable de faire fonctionner tous les capteurs séparément et l'affichage sur LCD.

Day 2

• 9h - 12h00 : On a continué de programmer la carte de façon à faire fonctionner les différents capteurs en même temps, tout en optimisant notre choix d'équipements ( alimentation autonome,

Ecran LCD Grove RGB à la place de l'ancien écran, ajout d'un second écran...)

• 13h30 - 18h00 : Optimisation du code et affichage des valeurs sur un seul écran en les alternants avec des codes couleurs.

(Pour la température, la couleur de l'écran vire du bleu au rouge proportionnellement à l'augmentation de la température.

Le buzzer sonne lorsqu'il y a beaucoup de pollution (Test effectué avec la voiture (très) polluante de Mr. Boulanger). La couleur de l'écran

change suivant l'indice UV sachant qu'on a programmé l'écran en respectant le code couleur des indices UV ==> Vert/Jaune/Orange/Rouge/Violet).

Exemple de la température : Dans cet exemple on a fixé la température à partir de laquelle la couleur de l'écran change à 24° uniquement pour le test.

Day 3

• 9h - 11h30 : On a amélioré la fonction du buzzer pour ne le faire sonner que 3 fois pour alerter l'utilisateur et non pas à chaque fois que la qualité d'air, tout en continuant d'afficher

le reste des valeurs à la fois dans le shell et sur l'écran LCD.

Nous avons également commencé la modélisation du boitier qui contiendra notre prototype et on s'étaient mis d'accord que la forme sera cubique et dont on exploitera 5 faces

(celle du haut sera dédiée aux capteurs, 3 seront dédiées aux Leds et à l'affichage des données et dans la dernière on mettra notre écran LCD.

• 11h30 - 12h30 : Présentation à l'IRAM concernant la modélisation 3D.

• 13h30 - 18h : On mis une fonction de temps afin de permettre au buzzer de recommencer à sonner après un certain temps (délai entre 2 alertes).

On a implémenté les LEDs qui seront sur les côtés et comporteront des informations complémentaires.

Dès que "High Pollution" s'affiche, le buzzer commence à sonner

Day 4

• 9h - 12h30 : On a programmé la carte de manière à ce que le programme se lance dès la mise du courant et sans l'intervention du PC.

• 13h30 - 18h00 : On a modélisé et imprimé le boitier qui contiendra notre objet.

On a commencé à filmer la vidéo de notre présentation.

Day 5

• 9h - 10h30 : On a fini le montage de notre vidéo et peaufiné les derniers détails.

• 10h30 - 12h45 : Présentation à l'IRAM.

• Vous trouverez la vidéo pour expliquer le fonctionnement du dispositif Interact,

ainsi que les 2 scripts python qu'il faut mettre sur la carte d'un côté pour implémenter le programme et de l'autre pour lancer le programme dès l'alimentation de la carte,

dans le lien suivant : https://drive.google.com/folderview?id=0ByL4GFJeYJtKM3hWUFJMZFlEMEU&usp=sharing